业内认为,随着技术的不断进步和应用场景的扩大,多模态大模型与机器人的需求将会不断增加,为企业提供了广阔市场空间。此外,与其他行业的合作也将为多模态大模型与机器人的发展带来新机遇,例如与医疗、制造等行业的合作,可实现更广泛的应用场景和商业价值。

多模态机器人实现技术突破

截至12月13日收盘,步科股份、埃夫特、绿的谐波等多只机器人概念股涨超4%。消息面上,特斯拉发布Optimus-Gen 2(第二代擎天柱)人形机器人视频,其搭载由特斯拉设计的执行器与传感器,行走速度提高30%,平衡力及全身控制均得到提高。

“多模态”AI是指能处理文本、音频、图像、视频和代码等多种形式内容的大模型。随着多模态大模型快速迭代,国际大厂不断关注其在机器人领域的应用,并在机器人规划、控制、导航等主要任务上进行了探索。

止于至善投资总经理何理告诉《证券日报》记者:“多模态大模型融合视觉、语音和传感器数据处理技术,极大丰富了机器人认知和决策层面。该技术在机器人中的应用,有望使机器人在复杂交互、自然语言理解和环境适应等领域迈出重大进步,激发其作为高度自主助手或劳动力的无限可能性。

国内已有企业在此领域抢先布局。12月12日晚,奥比中光发布大模型机械臂1.0产品,可通过语音prompts作为输入,利用多种大模型的理解能力和视觉感知能力,生成空间语义信息,让机械臂理解、执行动作。在其同步披露的视频中,机械臂成功完成了一系列语音口令,包括“把绿色方块放到黄色框中”“请恢复最开始的状态”等。

奥比中光联合创始人、CTO肖振中告诉《证券日报》记者:“公司希望通过工程化研究,使大模型机械臂在实际场景落地,包括提升机械臂自动绕开复杂障碍物来完成人类指令的能力,解决大模型+机械臂的泛化性问题,最终实现通用场景落地。

据不完全统计,中科创达、亿嘉和等上市公司亦于近期相继披露了基于多模态大模型的机器人研发进展情况。

大模型赋能人形机器人,具身智能是未来目标

人形机器人是软硬件能力高集成的实体,商业化的核心突破点在于“AI 大脑”。可以说,当前的 AI 大脑在逻辑思维和行为智慧决策层面还需要一段成长空间,其驱动力很大程度上来自于算法的升级与高水平的智能化。具身智能是人形机器人想要实现的最终方向。

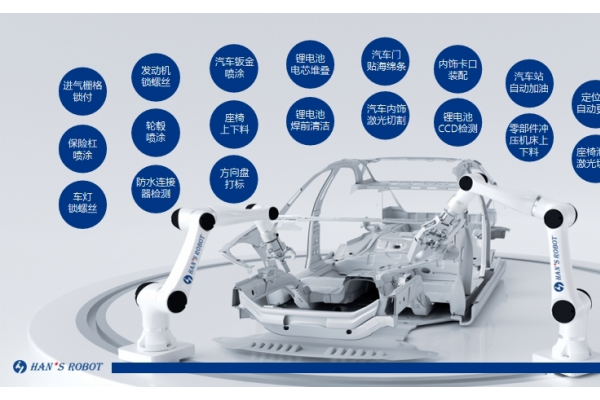

大模型为人形机器人的发展带来了新的突破。以往由于算法模型的局限,机器人难以实现通用化能力,只能通过对于某一个特定领域训练对应的基础模型,达到能够满足特定用途的机器人 AI 算法,比如工厂车间大量采用的机器人臂、家用扫地机器人等。软件层面的局限性限制了机器人的应用场景狭窄、可通用性较差,无法充分发挥硬件层面的性能。而大模型的出现,补全了让机器人能力实现跃升的技术基础。

大模型的向量应用提供了大脑给机器人,使机器人具备更高的事物处理能力。大模型的 Chat 应用把自然语言理解提供给了机器人,机器人首次可以用接近人的语言水平,和真实人类聊天,进行基于自然语言的互动。此外,大模型的编程辅助可以肉眼可见的减少软件工程师的工作量,产出软件的成本会逐年下降。

ChatGPT 已经在机器狗领域落地应用,人形机器人未来可期。今年4月,AI 公司 Levatas 与波士顿动力合作,将 ChatGPT 和谷歌的语音合成技术接入 Spot 机器狗,成功实现与人类的交互。可以说,ChatGPT 的成功,也为人形机器人这一更加高级的领域带来了发展拐点。以 ChatGPT 为代表的语言大模型能够实现近似人一样的自然语言交互,多模态大模型则能让人形机器人能够通过“视觉”去与环境交互。可以说,大模型赋予了人形机器人一个通识大脑,从而能够顺畅地和外界对话,还可以增加任务理解、拆分和逻辑推理等“决策”能力。

大模型的泛化能力让研究者看到人形通用机器人的曙光。以往的 AI 模型训练完成后,就只能用于其被设计出来的场景中,难以进行拓展,无法实现通用性。而大模型具备强大的泛化能力,让通用这一目标的实现成为了可能。

泛化(Generalization)可以理解为一种迁移学习的能力,把从过去的经验中学习到的表示、知识和策略应用到新的领域。人类就具有“举一反三”的能力,学习一个新概念后立即就能理解它在其他情况下的相关用法。以往的 AI 泛化能力很低,应用场景比较局限,泛化能力的出现让大模型能够在没有被训练过的场景中也能表现出色,是 AI 实现通用性的基础。人形机器人所面临的应用场景与人类的日常生活接近,需要面对多种多样、不重复、没见过的任务,模型的泛化能力就成为了其能否真正实现通用的核心要素。

多模态数据包含更多信息,端到端的算法训练框架提升模型泛化能力。图像、视频等多模态的数据拥有着比文字要多许多的信息,采用多模态数据的大模型有助于实现更高细粒度的语义理解、对话意图识别以及更精确的情感分析。综合使用多种数据模式的信息,可以显著提升模型的性能。 因此,端到端的训练方式会在机器人模型领域有更多优势。

以 GPT-4为首的多模态大模型已经具备成为通用性人形机器人核心大脑的初步条件。OpenAI 在10月正式上线 GPT-4V(ision)这一新版本,为 GPT-4新增了语音与图像功能。现在用户可以直接与 GPT-4V 进行语音交互,并且 GPT-4V 能够对图像进行推理和分析。根据微软团队对 GPT4V 的详细评测,GPT-4V 有作为具身机器人的理解核心的潜力。在微软的测试案例中,GPT-4V 可以扮演一名家庭机器人,阅读咖啡机的操作界面并给出正确的指令操作;或者通过房间图片的输入,要求 GPT-4V 规划出去厨房冰箱取物品的路线,GPT-4V 也可以执行面向任务的导航。具有多模态输入的 GPT-4V 在面对动态环境时可以很好地与环境交互,证明了GPT-4拥有成为人形机器人核心大脑的潜力。如果将GPT-4与合适的硬件进行结合,就有望实现具备GPT-4水平的具身智能。

鸿蒙系统扩大生态圈

11月17日,乐聚与深开鸿携手推出的国内首款基于开源鸿蒙(OpenHarmony)的人形机器人,引发了资本市场及科技行业的广泛关注。12月5日,乐聚机器人发布的首款高动态人形机器人。相较于前段时间发布的小尺寸人形机器人,这次发布的KUAVO(中文夸父)大尺寸的高动态人形机器人,重量约45kg,全身自由度26个,其步速最高可达4.6km/h,快速连续跳跃高度超过20CM,是国内首款可跳跃、可适应多地形行走的开源鸿蒙人形机器人。

目前的人形机器人几乎都是基于ROS(机器人操作系统)研发的,为什么乐聚要开此先例?基于OpenHarmony(开源鸿蒙)设计人形机器人?乐聚机器人副总裁高动态机器人项目负责人吴雨璁表示,首先,OpenHarmony是本土的开源操作系统,从人形机器人长远发展和应用场景来看,安全性更有保障。其次,OpenHarmony具有与外部传感设备数据互联、超级终端多设备连接的特性,能助力人形机器人更智能、高效的工作能力,使其更精准地完成工作。

吴雨璁表示,开源鸿蒙系统凭借其与外部传感设备数据互联、超级终端多设备连接的特性,便人形机器人具有更智能、高效的工作能力。通过与外部传感设备实现紧密互联,人形机器人能够更智能地感知周围环境,可以从事更需要精准度的工作。利用KaihongOS(深开鸿)软总线技术,机器人本体与周围环境和设备可以实现更智能的分布式协同,使人形机器人具有更好的交互体验,能力边界得到进一步拓展。

乐聚将人形机器人与开源鸿蒙操作系统深度融合,有望加速人形机器人在实际场景中的商业化进程,推动智能服务机器人在教育、医疗物流、家庭服务等领域的广泛应用。

据悉,乐聚团队对于Kuavo机器人的商业化路径已经有了规划:

第一阶段:在教育科研领域,协同各方组成创新联合体,攻克关键技术,打造开发生态。目前已与哈尔滨工业大学、苏州大学、山东大学、北京通用人工智能研究院等各大高校和研究院在研发方面展开了深度合作。

第二阶段,在特种、工厂、医疗等特定领域,面向恶劣条件、危险场景作业等需求,打造特定应用场景下高可靠人形机器人的产业化落地方案。目前,乐聚已与相关企业达成合作,将针对特种救援、高危作业等应用场景展开探索。

第三阶段,全面进入家庭等民生领域,满足生命健康、陪伴护理等高品质生活需求,开发具有复杂区域引导、灵活操作、鲁棒行走、多模态人机交互的解决方案,打造一款“像博士一样聪明,像家电一样便宜”的人形机器人。

人形机器人作为高度集成的平台,零部件方面涉及伺服电机、减速器、控制器、传感器等,软件方面包括环境感知、人机交互、机器学习、系统控制等,覆盖行业广,技术含量高。

乐聚表示:“人形机器人的发展高度依赖于产业生态的完善,这不是一家企业能够独自完成的任务。乐聚也致力于与更多上下游的伙伴共建产业生态,早日实现人形机器人的规模化应用。”